大模型进入加速发展的第二年,技术迭代和竞争更为激烈。令全球震撼的文生视频Sora世界模拟器、拥有更强智能的谷歌Gemini 1.5、Meta的世界模型的雏形V-JEPA同一天推出,Claude3超越了GPT4的能力。Open AI的GPT5呼之欲出,奥特曼不仅自研芯片、还投资了数家可控核聚变公司,储备未来的关键资源——算力和能源。

在算力紧平衡、数据资源荒即将到来的背景下,面对纷繁复杂、日新月异的变革,笔者试图对未来大模型的发展做出一点预判,纯属个人研究中的感受,供大家参考。也非常欢迎大家探讨交流,批评指正,共同迭代认知,一起进步。

判断一:中国基础大模型的数量会快速收敛,卷不动了

据不完全统计,中国有超过200个大模型,也被称为“百模大战”。但进入2024年,随着Claude3等基础大模型能力的加速提升,Sora视频大模型能力的惊人进步,国内一些资源不强的,以及所谓的“套壳”大模型厂商会望而却步,无法保证在算力资源、人才密度上的持续跟进,进而放弃在基础大模型领域的投入,行业将呈现几家大厂+10家以内明星创业企业同台或联手竞技的格局。

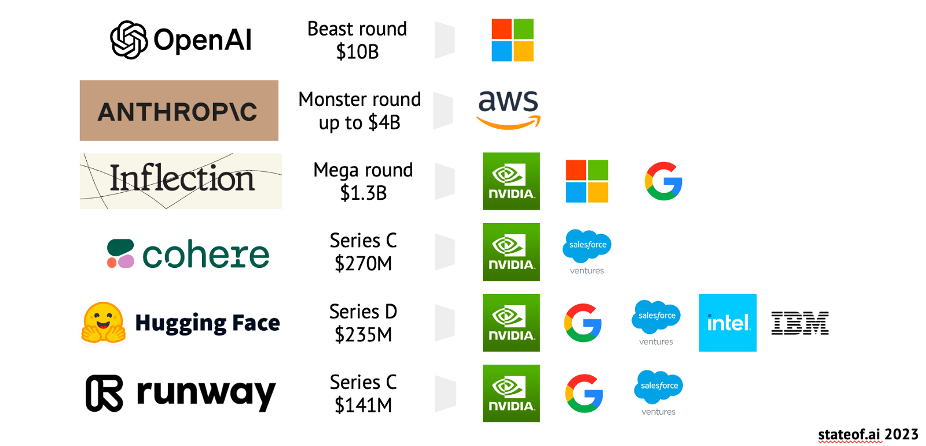

从国外看,大厂加创业公司的模式,是行业的一个突出特点。比如微软和Open AI,谷歌和Deepmind,亚马逊和Anthropic的组合。就连过去投资活动并不显著的芯片巨头英伟达,2023年也投出了35个生成式AI相关项目,比2022年多6倍。而且从国外来看,基础大模型领域,也并未出现百模大战的“盛景”。

判断二:万卡是一个入门的算力

近日有媒体报道,AI问答引擎Perplexity的创始人兼首席执行官Srinivas 在《Invest Like The Best》播客的最近一期节目中表示:“我试图从Meta聘请一位非常资深的研究员,你知道对方怎么回应吗?——等你有了10000 块 H100 GPU再来找我。”

虽然只是一则招聘吐槽,但也表明了当前基础大模型训练对算力的巨大需求。在“大力出奇迹”的大模型范式下,算力的多少一定程度上决定了智能的高低。据传GPT4训练大概用2.5万张A100,GPT5训练大约用5万张H100(约等同于15万张A100的算力)。扎克伯格近期表示,计划今年年底前向英伟达购买35万张H100芯片,将形成相当于60万张H100的总算力,训练Llama 3大模型,以追赶GPT5。据报道,0pen Al创始人奥特曼正在筹集多达7万亿美元资金,用于自研AI芯片,以推动其大模型的迭代。(被业界质疑夸张,因2023年全球半导体市场规模为5330亿美元)

反观国内,2023年前三季度,根据英伟达中国营收推算,中国约新购买了相当于58万张A100的算力,但还远不如Meta一家企业从英伟达获得的算力。美国芯片禁令下,中国无法补充先进算力,导致处于严重被动。国内芯片厂商如华为、海光等,受制于产能问题,供货量距离大模型训练需求尚有较大缺口。同时,相比CUDA,国内软件生态薄弱,国产AI芯片普遍存在适配周期长、成本高、难度大等问题,无形中延长了国产大模型训练周期。

判断三:大模型的能力取决于一个团队金字塔顶尖人才的认知,小团队也能涌现高智能

大模型是一个复杂的算法和工程难题,而这一轮大模型的发展,很大程度上是由顶尖人才驱动的,人才密度和强度至关重要。OpenAI的三位灵魂人物是CEO Sam Altman、总裁Greg Brockman,以及图灵奖得主辛顿的爱徒,首席科学家伊利亚。他们在Open AI成立的前七年间,在无收入的情况下,坚定AGI信仰,并持续投入数十亿美元,即便受到无数的不解和嘲讽也保持初心,才造就了ChatGPT一鸣惊人的神话。

被寄予厚望的Claude模型公司Anthropic,是由OpenAI 前研究副总裁Dario Amodei、GPT3论文一作Tom Brown等人在2021年共同创立。创始成员大多为 OpenAI的核心员工,曾经深度参与过GPT3、引入人类偏好的强化学习等多项研究。创始成员对于大模型的深刻理解,是Claude3今天取得突破性进展的重要原因。

Character.ai是用户访问量仅次于GPT的聊天陪伴应用,这家独角兽虽然只有22人,但其创始人Noam Shazeer是Google的前 200 号员工,在Google工作的 17 年中,他参与了Google的一系列AI项目和研究,是《Attention is All You Need》论文,也就是Transformer架构的核心作者,以及Google LaMDA项目的核心成员。

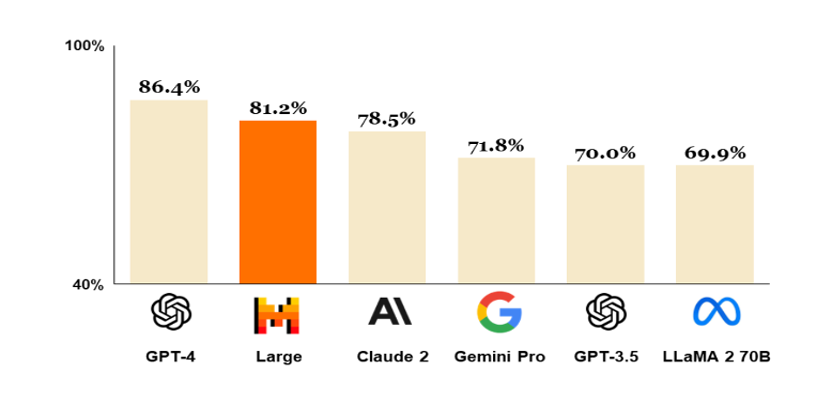

在开源领域效果和口碑很好的Mistral,人数也仅有20多人,成立于2023 年5 月。公司由前DeepMind、前Meta科学家创办而成,具备深厚的技术背景。三位创始人皆具有大模型开发经验,参与过LLaMA系列大模型的开发。在基准测试中以81.2%超越了谷歌Gemini Pro、GPT3.5、Meta Llama 2-70B三款模型,仅次于GPT4。

判断四:开源大模型难以胜过闭源

开源是软件领域多年来的重要趋势,全球优秀的开发者在各种开源软件上的持续贡献,不仅持续优化软件版本,也造成了各类应用生态的繁荣。可以说,开源对于当今的IT技术体系的发展功不可没。

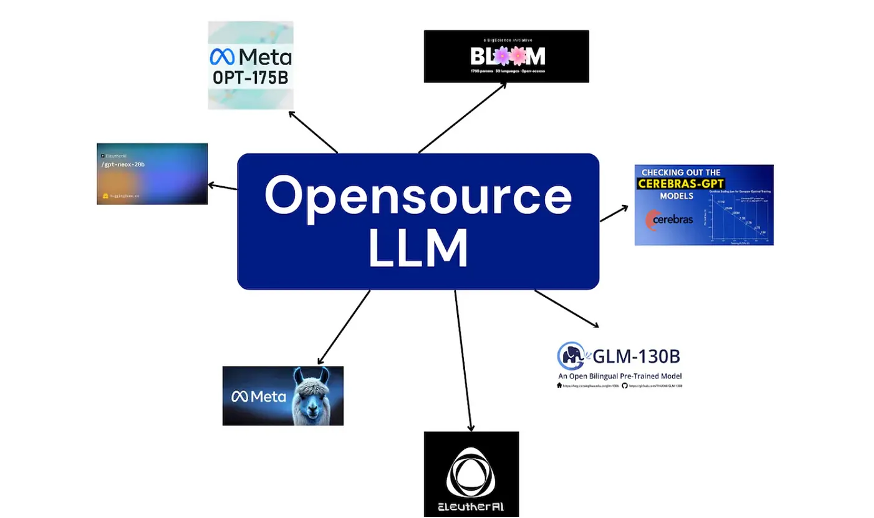

但从GPT3开始,Open AI选择了闭源的方式,让最领先的大模型的开源之路戛然而止。当前,业界口碑较好的开源大模型基本均处在GPT3.5的水平,包括Meta的LLaMA2,Mistral的Mistral 8x7B、智谱的ChatGLM-6B、GLM-130B等。2月底,谷歌开源了Gemma系列模型,分为2B和7B两种尺寸,2B版本可直接在笔记本电脑上运行。近日,马斯克也表示,本周将开源xAI自己的大模型Grok。

对于大模型而言,每一个大版本的迭代都具有很强的代际碾压效应,这导致很多基于GPT创业的小公司面临一夜之间倒闭的风险。如读文件的ChatPDF、明星独角兽Jasper等,都被GPT的更新所碾压。甚至有行业开发者表示,千万不要基于 Open AI 做 PaaS,否则必然会被 Open AI 的下一个版本替代。因此,在原有开源基础模型上做优化的方式,很可能被下一个版本的功能所替代。而且更为重要的是,原有的开源方式更适合做生态,即在底层内核保持相对稳定的基础上,通过开源来实现应用的创新,但受限于算力和算法等,开源生态的开发者没有能力对基础大模型给予能力迭代的贡献,这使得原有集众智的开源模式很难在基础大模型自身的快速演进上复现。

判断五:能走多远,取决于对AGI和Scaling Law的信仰

以Open AI为代表的大模型企业对AGI的信仰,开始获得了越来越多的认同,Sora从视频理解到世界模拟器的路径,杨乐昆的世界模型构想,都是产业界希望通往AGI的努力。

大力出奇迹的范式,在当下证明是最为有效的路径,包括Sora的成功,也再次验证了除文字领域,视频领域的Scaling Law也同样有效。Open AI把Scaling Law作为企业的核心理念,其原话为:“We believe that scale-in our models, our systems, ourselves, ourprocesses, and our ambitions-is magic. When in doubt, scale it up”

判断六:个人应用要过千万月活门槛

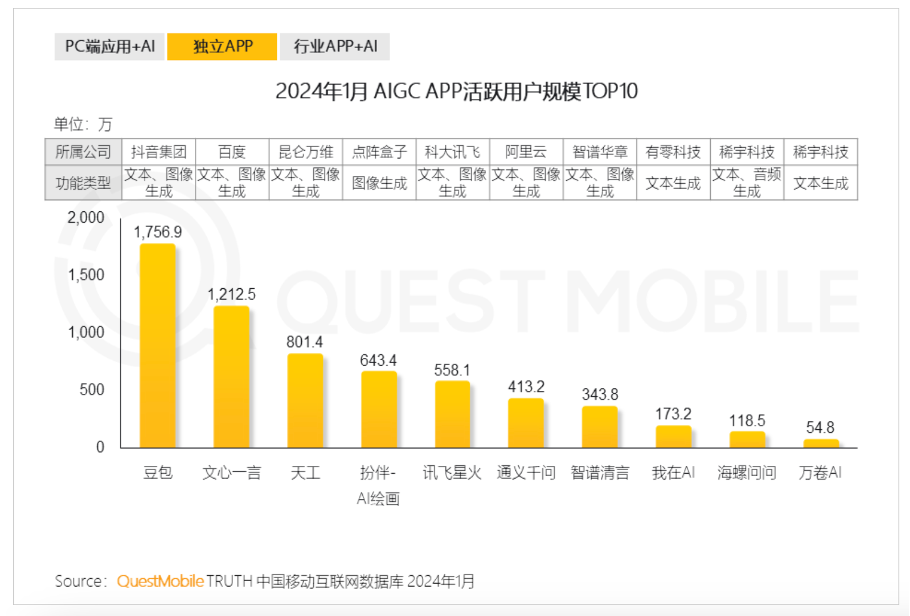

与移动互联网时代的APP动辄上亿用户不同,中国AI 原生APP的成长速度并不算快,头部的APP也刚刚突破了月活千万的门槛。根据笔者个人的感受,即使是互联网圈,身边的小伙伴也有很多同学没有用过国内的这些APP,更不论三四线甚至五六线城市。

根据QuestMobile2024生成式AI及AIGC应用洞察报告,头部APP应用去重月活用户突破5000万。现阶段头部应用普遍聚焦在文本和图像信息模态生成;豆包、文心一言以月千万活跃用户规模“领跑”,其次是天工、扮伴-AI绘画及讯飞星火。

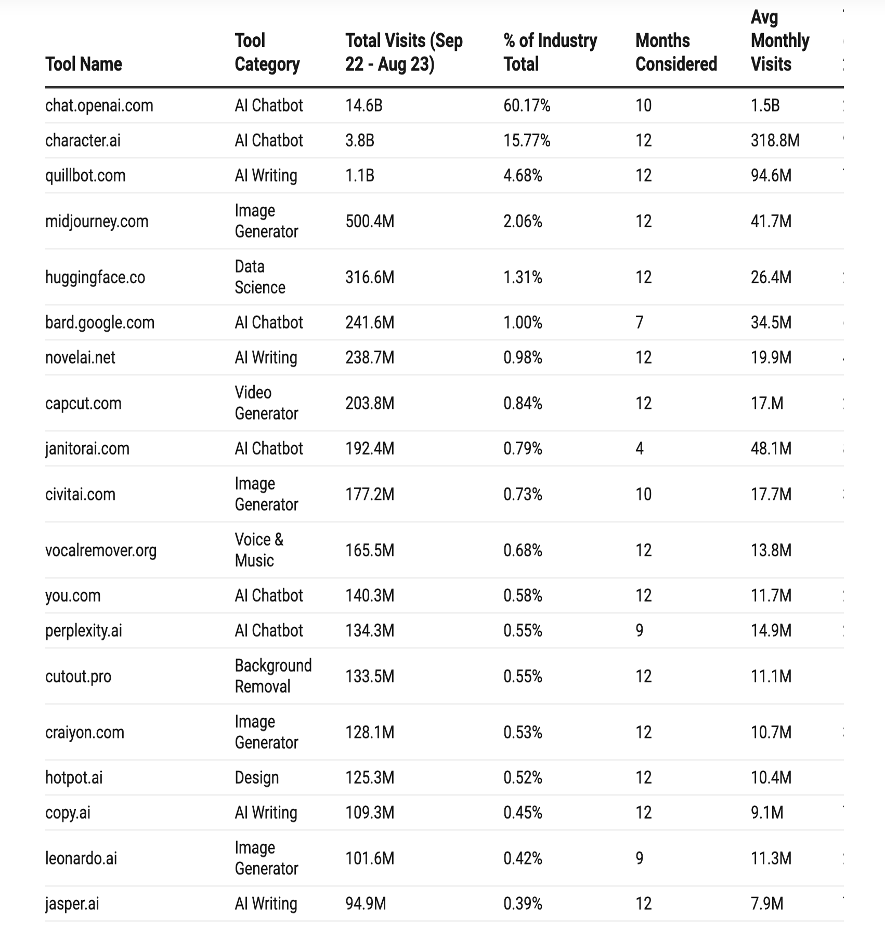

相比而言,2022 年 9 月至 2023 年 8 月期间,全球排名前 50 的人工智能工具吸引了超过 240 亿次访问。ChatGPT 以 140 亿次访问量领先,占分析流量的 60% 以上。

判断七:手机端侧大模型将加剧和超级APP的入口之争

大模型正在向端侧转移,AI推理将在在手机、PC、耳机、音箱、XR、汽车,以及其它可穿戴式新型终端上运行。端侧大模型具有一些独特优势,如,本地数据处理效率更高,节省云端服务器带宽和算力成本,对用户数据更好的隐私保护,开启更多交互新方式、新体验等。

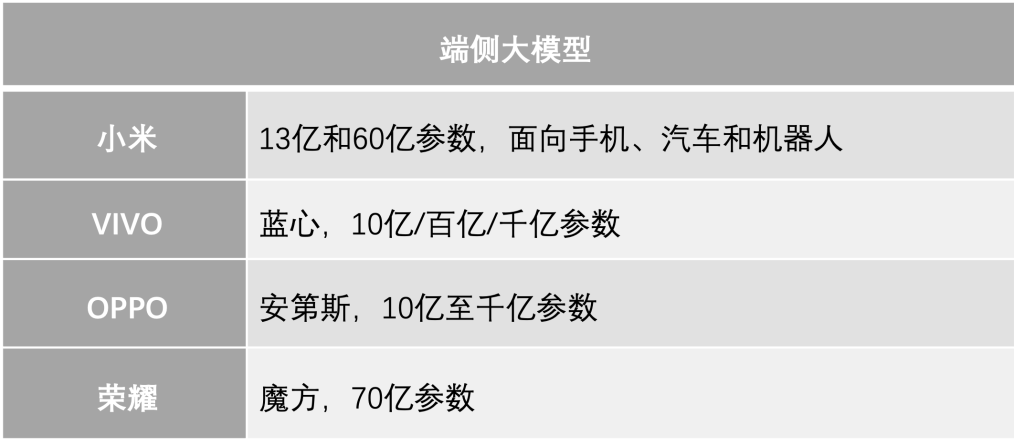

未来借助端侧大模型,并结合向量化后的各类个人数据,用户可以跟手机进行更流畅的交互,实现各种原生操作和功能。如,小米的MiLM,VIVO的蓝心大模型、OPPO的安第斯、荣耀的魔方等端侧大模型。还有Humane 推出的 AI Pin,搭载GPT4,可实现语音交互,也可以投影在手掌上交互。高通推出骁龙8 Gen3 ,支持终端侧运行100亿参数的模型。苹果最新的M3芯片支持端侧推理,且计划推出更智能的Siri,为端侧大模型生态做积极准备。

但同时,很多端侧大模型的愿景是成为新的手机交互入口,比如只要跟手机助手聊天,就可以帮助点外卖、打车、购物,甚至发短信、发微信等等。如果实现,手机就有可能OTT掉大量APP,使得APP沦为后台为手机打工的角色。同时,这也进一步加剧了手机企业在生态内的话语权,让苹果税、鸿蒙税等更为持久和强势。

判断八:效率、体验、创造是当前大模型落地三大核心价值

效率自不必说,大模型仍然是机器提升自动化的逻辑。体验和创造是这一波大模型落地更为特别的驱动力。体验方面,一方面是交互更加友好,从人要去适应机器(无论是学Dos,还是后来的键盘鼠标输入)到机器来适应人(机器可以理解人的指令、语言甚至动作、姿态、情感)。另一方面,是出现了很多陪伴类的APP,即提供情绪价值类的原生APP。在这个过程中,也形成了一些亚文化,比如多推、单推、养崽等行为,以及使用中的脱皮、上皮、下皮等情形。

创造是生成式大模型天然的能力,当前在文字和图片创作、传媒影视、广告、短视频、甚至游戏等领域,已经大量引入AIGC的内容。在这些领域,大家一直诟病的模型幻觉问题,也有可能以另外一种创造的方式给人带来更多灵感启发。同时,创造还在AI4S领域有更大的想象空间,AI科学家可能就在不远的未来。例如,谷歌人工智能实验室DeepMind开发的深度学习工具“材料探索图形网络”经过 17 天的连续工作,A-Lab 进行了355 次实验,合成了 58 个拟定化合物中的41 个,成功率达到了 71%,平均每天产出的新化合物数量在2 个以上。

判断九:未来可能出现更多的一人企业

随着大模型能力的提升,以及AI Agent的发展,个人将有望获得更多的智能化工具支持。畅享未来,一个人可能拥有多个助理来协助工作,此时,对个人领导力和判断力的要求也会大幅提升。

一人企业的趋势,对未来大企业的组织方式也会产生很大的影响。组织内的个人,其角色也会由单一变得更为多元,如一人可以身兼产品经理、工程师、UI等多角色。企业内也会出现大量的数字员工,数字员工的多少和质量,会成为企业的核心竞争力之一。

判断十:“技术派”VS“变现派”的争论在3年内会有定论

最近“小珺访谈录”的两篇文章,分别访谈了杨植麟和朱啸虎,两人的观点可以说是针锋相对。按照小珺的观点:中国科技界针对大模型的态度已分裂成两股阵营。一股是技术信仰派,他们大多技术出身,认为应该像OpenAI一样信仰AGI、信仰scaling law(规模定律),思维更偏硅谷。在他们眼中,随着模型能力跃升、模型成本降低,过程中会解锁丰富的应用。倘若不追求“更大更强的AI能力”,一旦其他人的模型飞跃,很快会降维碾碎现有根据地与护城河。另一股是市场信仰派,他们信奉陡峭的技术曲线终有放缓的一天,只需将“足够的AI能力”投入可以快速变现的商业场景中,用中国市场庞大而独特的数据构筑壁垒。这类人往往在中国丛林式的商场中浸泡更久,思维更偏本土。

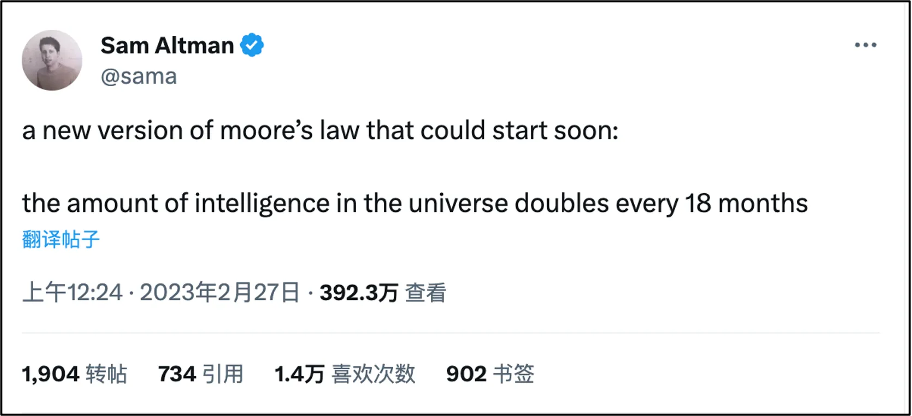

这种思维其实反映了很典型的长期主义和实用主义的争论,Open AI的成功,为我们坚持长期主义带来了很强的激励。按照奥特曼定律,智能每18个月升级的方式,预计到2026年,我们将迎来GPT6甚至更强的模型。届时,虽然还未达到AGI,但模型能力已经可以完成大多数人类社会的任务场景,从而变得更有商业价值。

在这个过程中,幻觉率的降低,是需要技术着力解决的问题。如果这个问题长期难以得到解决,会大幅影响行业的落地效果。也许,未来大模型会能够像人一样,会对回答给出一个置信度的概率,让我们知道哪些是仅供参考,哪些是确定性的判断。

本文作者:王齐昂 独立科技观察者